专栏名称: Python开发者

| 人生苦短,我用 Python。伯乐在线旗下账号「Python开发者」分享 Python 相关的技术文章、工具资源、精选课程、热点资讯等。 |

今天看啥

公众号rss, 微信rss, 微信公众号rss订阅, 稳定的RSS源

目录

相关文章推荐

|

|

Python开发者 · GPT-5 太糟糕了 · 20 小时前 |

今天看啥

›

专栏

›

Python开发者

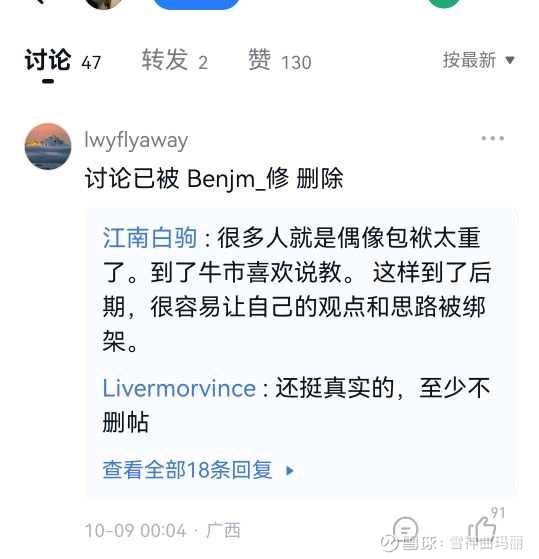

微软AI公开折磨微软员工,修Bug唯一贡献是改了PR标题,GitHub评论区成吃瓜现场

Python开发者 · 公众号 · Python · 2025-05-26 08:12

推荐文章

|

|

Python开发者 · GPT-5 太糟糕了 20 小时前 |

|

海通研究 · 海通非银 | 投资收益改善,关注保险中报 11 月前 |

|

人力资源和社会保障部 · 灵活就业人员的档案存哪里? 2 天前 |